この記事でわかること

- AIエージェントの正確な定義と、生成AI(ChatGPTなど)との違い

- 2026年に急加速する「マルチエージェント化」「イベント駆動型」トレンドの実態

- 種類・仕組み・業界別の活用事例と、失敗しない導入の進め方

- セキュリティリスクとガバナンス(AI TRiSM)への実践的な対処法

1. AIエージェントとは?

AIエージェントとは、アプリやクラウドといったデジタル環境、さらにはロボットやセンサーといった物理的な環境において、AIの手法を用いて状況を把握・判断・行動し、自律的または半自律的に目標を達成するソフトウェアです。

人が細かい指示を出さなくても、最小限の監督のもとで、さまざまなタスクや環境に適応して動作できる点が最大の特徴です。

わかりやすい例を挙げると「来週の出張を手配して」と伝えるだけで、AIがフライトを検索し、予算と照合し、ホテルを予約し、カレンダーに登録する——そうした一連の作業を人が細かく指示することなく完遂するのがAIエージェントです。

2025年のAI導入率は前年比282%と急増(Salesforce調査)しており、一部の企業において、2026年は「PoC・実証実験の年」から「ROIを出す実行の年」へと移行するフェーズに突入しています。

2. 生成AIとの決定的な違い

「ChatGPTと何が違うの?」という疑問は非常によく聞かれます。端的に言えば、生成AIは「答える」ツール、AIエージェントは「動く」システムです。

| 観点 | 生成AI(ChatGPTなど) | AIエージェント |

|---|---|---|

| 主体性 | 指示が来たら応答を生成 | 目標に向けて自ら計画・実行・見直す |

| 対応力 | プロンプトの質・具体性に依存 | 現場の変化に合わせて方針を自律調整 |

| 仕事の型 | 単発の作成・要約・草案に強い | 複数ステップの継続業務に強い |

| 連携 | 単体で回答生成が中心 | ツール/APIや他エージェントと連携 |

| 人の役割 | 良いプロンプト作成・最終判断 | 目標設定・ルール設計・監督 |

生成AIは「よい質問をすれば、よい回答が返ってくる」受け身の仕組みです。それに対しAIエージェントは「目標設定→計画立案→実行→結果報告」まで自律的に担い、途中で環境が変われば作戦も変えます。

具体例で比較

- 生成AI:「問い合わせの返信文を作って」→文章が返ってくる。次に何をするかは人が決める

- AIエージェント:「今週の問い合わせを自動で仕分けして、急ぎは担当者に回す」→状況を見ながら段取りを決め、必要であれば他のエージェントとも連携して最後まで進める

3. エージェント型AI(Agentic AI)との違い

市場では「AIエージェント」と「エージェント型AI(Agentic AI)」の2つの用語が混在しており、混乱を招いています。ガートナーの定義を整理すると以下のようになります。

AIエージェントは、特定のタスクを実行するための自律的なソフトウェア・プログラムです。エージェント型AIは、それよりも包括的・進化的な概念で、組織に代わって自律的に意思決定を下し、アクションを起こす権利を付与されたゴール主導型のソフトウェア・エンティティです。

自律性の進化順で整理すると「チャットボット → RPA → AIエージェント → エージェント型AI → AGI(汎用人工知能)」となります。ガートナーは「エージェント型AI」を2025年の戦略的テクノロジのトップ・トレンドのひとつと位置付けており、責任あるイノベーションによって未来を形成する上で重要と指摘しています。

4. AIエージェントの仕組み

AIエージェントは「目標の理解→計画→ツールの実行→学習」という一連のサイクルを回します。このプロセスを担う主要な機能は以下の通りです。

頭脳となる主要機能

- 計画と推論:目標を小さな手順に分解し、「今何をすべきか」を決定する

- メモリ管理:直前の会話や過去の知識を保持し、必要な時に取り出す(ステートフル型)

- ツール利用:検索エンジン、社内システムAPI、RAG(検索拡張生成)などの外部機能を呼び出す

- 行動・観測ループ:「観測→判断→行動→再観測」を繰り返して目的に近づく

オーケストレーションの役割

複数の機能やエージェントをつなぐ「まとめ役」がオーケストレーターです。セッション状態の管理、プロンプトの送受信、LLM応答の解釈、APIの呼び出し、他エージェントとの連携を一手に担います。

ステートフルとステートレスの違い

- ステートフル:過去のやり取りを保持し、パーソナライズされた応答が可能

- ステートレス:すべてのリクエストを独立したものとして扱う

業務上の継続性が必要なユースケース(カスタマーサポート、プロジェクト管理など)ではステートフル型が、シンプルな照会応答にはステートレス型が適しています。

5. AIエージェントの6つの種類と活用例

AIエージェントには複数のタイプがあり、それぞれの特性が重なることもあります。代表的な6タイプを解説します。

① 反射エージェント

現在の入力と過去の知覚をもとに、決められた条件に従ってすばやく判断・行動します。ルーチン業務の自動化に最適です。

主な活用例

- 旅行予約:ユーザーの日時・予算を受け取り、交通と宿を即時提案。空席・料金変動に合わせて再提案まで自動化

- 保険金請求の一次処理:提出書類と契約データを照合し、不備を検知してリスト化

- メール管理:差出人・件名・本文のルールで自動分類し、定型返信の下書きを作成

② 目的ベースのエージェント

設定した目的の達成に向けて、環境に反応するだけでなく自ら手順を組み立てて能動的に動きます。

主な活用例

- 営業・顧客サービス:商談の停滞案件をCRMから自動特定し、フォロー案を生成して成約率を向上

- 調達:提案依頼書の下書き作成や契約要点の要約による業務効率化

③ 有用性ベースのエージェント

複数の行動選択肢を比較し、最も「有用性が高い」行動を選びます。トレードオフを考慮した意思決定が必要な場面で力を発揮します。

主な活用例

- 金融:市場状況・リスク・リターンを総合的に判断してポートフォリオを最適化

- ロジスティクス:配送コスト・時間・顧客満足度を同時に最適化する経路選定

④ 学習エージェント

過去の経験から継続的に学び、精度を高めていきます。使えば使うほど賢くなる点が最大の特徴です。

主な活用例

- 通信:ネットワークの自動監視・異常検知で障害を未然に防止

- 小売:購買履歴や行動データを学習し、精度の高いレコメンドを実現

⑤ 階層エージェント

複数のエージェントが階層構造で協調し、上位エージェントが下位エージェントを指揮します。複雑な業務フローの自動化に適しています。

⑥ コラボレーティブ・エージェント

役割の異なる複数のエージェントが水平に協調し、タスクを分担して処理します。後述のマルチエージェントシステムの基盤となる考え方です。

6. マルチエージェントシステム(MAS)とは

マルチエージェントシステム(MAS)は、複数のAIエージェントが協調して複雑なタスクを処理する仕組みです。個々のエージェントが特定の役割(情報収集、分析、実行、レポート作成など)を担い、互いに通信・連携しながら一つの目標に向かいます。

2026年の主要トレンドとして、単一のAIエージェントは「デジタル上で孤立した存在」となり、マルチエージェントシステムへの移行が企業競争力の鍵とされています(Salesforce予測)。

マルチエージェント化を成功させるためには3つの技術基盤が必要です。まず、オープンな相互運用性のためのマルチエージェントプロトコル(MCP、ACPなど)、次にエージェント間でコンテキストを共有できるデータ統合基盤、そして全エージェントのセキュリティと可観測性を確保するガバナンス体制です。

7. 【2026年最新】注目トレンド:イベント駆動型・フィジカルAI・AIと物理世界の融合

トレンド① ユーザー主導型からイベント駆動型へ

2025年までのAIエージェントは「人が指示を出すと動く」ユーザー主導型が中心でした。2026年はイベント駆動型への移行が加速しています。例えば、あるAIエージェントがシステムのパフォーマンス低下を検知すると、人の指示なしに自動で開発エージェントに通知し、問題の分析・修正・テストを実行するという連鎖が実現しつつあります。

トレンド② シミュレーション「ジム」による学習加速

2026年のキーワードとして注目されるのが、シミュレーション環境(ジム)によるAIの高速学習です。現実世界の許容速度を超えて練習・失敗・改善を繰り返すことで、より安全で賢いAIエージェントを大規模に展開できる環境が整いつつあります。

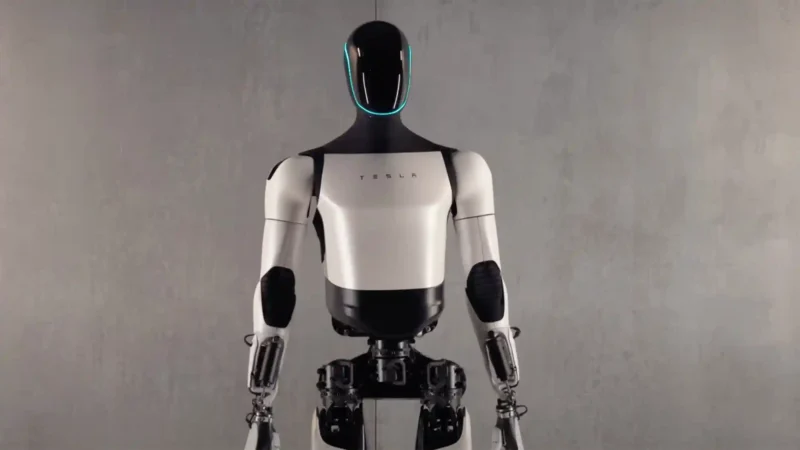

トレンド③ フィジカルAIとロボットの台頭

2026年は、AIが物理世界で動く「フィジカルAI」が本格的なトレンドとして定着します。NVIDIAのジェンスン・フアンCEOはCES 2026の基調講演でこれを「フィジカルAIのChatGPTモーメント」と表現しました。ボストン・ダイナミクスは2026年出荷分のヒト型ロボット「Atlas」がすでに受注済みであることを発表しており、製造・物流・医療分野での実装が進んでいます。

トレンド④ Human-in-the-Loopの標準化

自律性が高まる一方で、重要なアクションの前に人間の承認ステップを挟む「Human-in-the-Loop(HITL)」設計が標準化しつつあります。2026年現在、多くの先進企業では、AIエージェントの自律性レベルを業務ごとに設計し、外部送信・システム更新などリスクの高い操作には必ず人の関与を設けています。

トレンド⑤ AIエージェントのセキュリティ危機

2026年2月、MIT・ケンブリッジ大学・ハーバード大学・スタンフォード大学などの共同研究チームが主要30のAIエージェントシステムを調査した報告書を公開し、現状は「セキュリティ上の悪夢」とも言える状態であることを指摘しました。開発者による情報開示が著しく不足しており、エージェントが何をしているかを正確に把握する手段が確立されていないケースが多数存在します。停止機能を持たないエージェントシステムも複数確認されており、ガバナンス整備が急務となっています。

8. 業界別の導入事例

金融・保険

- 不正調査:口座データの自動整理・要約でコールセンター業務を大幅削減

- 引受審査の支援と保険金請求の自動処理

- 慢性疾患患者の受診・服薬履歴の監視と自動フォローアップ予約

製造・ロジスティクス

- ソフトバンクのロジスティクス部門でAIエージェントを導入し、配送効率を40%向上(国内事例)

- ダイナミック・ケース管理:物流・サプライチェーンで状況に応じてリアルタイムに手順を切り替える自動化

通信

- ネットワークの自動監視・異常検知による障害の未然防止

- 異常が検知された瞬間に修復エージェントへ自動エスカレーション

小売・EC

- 購買データ分析に基づくレコメンドと自動応答で顧客体験を向上

- ベイン・アンド・カンパニーは2030年までに米国eコマース売上の15〜25%をAIエージェントが担う可能性があると予測

開発・IT

- AnthropicのClaude Codeなどに代表されるコーディングエージェントが本格普及。2025年に開発者は業務の約60%でAIを活用(Anthropic調査)

- 要件定義書からディレクトリ構成・主要ファイル・テストコードまでを自動生成

- 新しいコードベースへのオンボーディングが数週間から数時間に短縮

人事・採用

- 採用プロセスの効率化(候補者スクリーニング、面談日程調整)

- 従業員向けセルフサービス(給与・福利厚生照会の自動対応)

9. AIエージェントを活用するメリット

AIエージェント導入の主なメリットは以下の3点に集約されます。

業務効率化と24時間稼働:繰り返し作業を自動化し、人間は創造的・戦略的な業務に集中できます。カスタマーサポートや問い合わせ対応は、時間・人員に関わらず安定的に稼働します。

スケーラビリティ:繁忙期や急増するタスクに対して、追加の人材コストなしに対応量を拡大できます。3人のチームが数日でグローバルキャンペーンを開始できるような「人の力の拡張」が現実になりつつあります(Microsoft予測)。

データ駆動の意思決定:膨大なデータをリアルタイムで分析し、人間の判断を上回る精度で最適解を提示できる場合があります。Microsoftの医療AIは複雑な症例を85.5%の精度で解決し、経験豊富な医師の平均正答率20%を大きく超えた事例も報告されています。

10. AIエージェントのリスクとセキュリティ課題

AIエージェントの自律性が高まるほど、リスクの範囲も拡大します。導入前に把握しておくべき主要リスクを整理します。

セキュリティリスク

2026年2月のMITなどの共同調査によれば、多くのAIエージェントには以下の問題が確認されています。

- 個別の実行トレース(何を実行しているか)が公開情報から判別できない

- AIであることを外部に自動開示しないエージェントが大半を占める

- 一部のシステムには稼働中のエージェントを停止する手段が存在しない

- 使用状況の監視機能を持たないか、利用制限到達時のみ通知するシステムが多数存在する

ハルシネーション・リスク

誤った判断や事実と異なる内容をもとに行動すると、社外への誤情報送信など業務への影響が拡大します。自律性が高いほど影響範囲も広がるため、送信前の承認フローや特定条件下での実行制限ルールが不可欠です。

法的責任とガバナンスの課題

エージェントが自律的に行動した結果の責任は誰が負うのか、という問題は2026年時点でも法整備が追いついていません。EU AI法をはじめとする国際規制への対応が、グローバル展開を行う企業の導入判断に影響します。

コスト管理

自律型エージェントはAPI利用回数が増えやすく、従来のチャット型AIよりもコストが膨らむ傾向があります。削減できた作業時間・人件費と月間APIコストを比較したROI算出が、継続的な活用の前提条件となります。

11. AIのリスク管理手法「AI TRiSM」とは

ガートナーが提唱するAI TRiSM(AIのトラスト・リスク・セキュリティ・マネジメント)は、AIの「信頼性・リスク・セキュリティ」を一体的に管理するフレームワークです。AIモデルやアプリの企画から運用・改善の全期間にわたり、ガバナンス・公平性・データ保護を確保することを目的としています。

AI TRiSMの主な構成要素

- ガバナンス:AI資産を管理するための方針・手順を整え、法規制・倫理に適合させる

- リスク管理:プライバシー、セキュリティ脆弱性、バイアスなどAI特有のリスクを特定・低減する

- セキュリティ:攻撃への耐性確保と、AIモデル・学習データの完全性を守る

- 監視と評価:AIの性能・信頼性・ポリシー遵守を継続監視し、必要に応じて迅速に調整する

AIの活用が広がるほど、データ侵害・ハルシネーション・サードパーティリスクといった課題が増えます。AI TRiSMは「AIのふるまいが企業の意図と一致しているか」を常に確認・是正することで、社内外の信頼を高め、導入リスクを抑える役割を果たします。

なお、ガートナーは2027年末までにエージェント型AIプロジェクトの40%以上が「コストの高騰、ビジネス価値の不明確さ、不十分なリスクコントロール」を理由に中止されると警告しています。AI TRiSMのような体系的なリスク管理が、長期的な成功の鍵を握ります。

12. 失敗しない導入の3つの基準

基準① 統合性——既存ツールとつながるか

AIエージェントは単体では価値を発揮しません。Slack・Teams・Salesforce・自社データベースなど、日常業務で使われているシステムと連携して初めて効果が生まれます。API連携が容易なツールほど現場への定着が早い傾向があります。

基準② 自律性のレベル設計——どこまで任せるか

「下書き作成まで」に留めるのか、「送信・実行まで」任せるのかで、効果とリスクは大きく変わります。特に外部へのメール送信やシステム更新を伴う業務では、Human-in-the-Loop(人間の最終承認)が不可欠です。自律性の度合いを業務ごとに柔軟に設計できるかどうかが、実運用における使いやすさを左右します。

基準③ セキュリティとガバナンス

社内データを参照するRAG構成では、情報漏えいを防ぐための厳格な権限管理・ログ管理が必要です。また、AIの学習にデータが利用されない設定が明文化されているかも重要な確認ポイントです。EU AI法など国際的な規制への対応状況も、長期的な視点から必ず確認しましょう。

スモールスタートの重要性

AIエージェントは、いきなり全社展開する必要はありません。まずはリサーチ業務・議事録整理・メール仕分けなど、リスクの低い業務から小さく始めることが成功の近道です。「自社のデータがどこにあり、どの業務を任せたいか」を軸に選定することで、最短距離で成果につながります。

13. よくある質問(FAQ)

Q. AIエージェントと自動化(RPA)は何が違いますか?

A. RPAは決められたルールに従って同じ操作を繰り返す「ロボット自動化」です。AIエージェントはルールが明確でない状況でも自律的に判断し、状況の変化に適応できる点が異なります。自律性・適応性・推論能力の有無が最大の違いです。

Q. 無料で使えるAIエージェントはありますか?

A. OpenAIやDifyのクラウド版には無料枠がありますが、業務利用では有料プランの検討が一般的です。

Q. 導入にプログラミング知識は必要ですか?

A. 2026年現在はノーコード・ローコードツールが主流となっており、Dify・Coze・n8nなどは非エンジニアでも構築可能です。ただし、複雑なカスタマイズや企業システムとの深い統合には技術知識が必要になる場合があります。

Q. AIエージェントはいつでも止められますか?

A. すべてのシステムがそうとは限りません。MIT等の2026年調査では、停止機能を持たないAIエージェントシステムが複数確認されています。導入前に「緊急停止」「権限の取り消し」「動作ログの確認」ができるか必ず確認してください。

Q. AIエージェントが誤った行動をした場合の責任は誰にありますか?

A. 現時点では法的な整備が不完全であり、導入企業が実質的な責任を負うケースがほとんどです。Human-in-the-Loopの設計とログの保全が、リスク管理の基本となります。

まとめ

AIエージェントは、「指示待ちのツール」から「自律的に動くデジタル労働力」へとAIを進化させる技術です。2026年は、PoC段階を超えて企業が実際のROIを追求する「実行の年」となっています。

同時に、MITなどの研究が示すようにセキュリティやガバナンスの課題も現実のものとなっており、ガートナーは過度な期待から生まれたプロジェクトの40%以上が2027年末までに中止されると予測しています。

成功の鍵は「自律性の高さ」ではなく、「業務に合った自律性のレベル設計」「既存システムとの統合」「Human-in-the-Loopによる安全設計」の3つです。小さく始め、成果を確認しながら段階的に拡大する戦略が、2026年以降の競争力を決めます。

関連:最近流行しているOpenClawが面白い!

関連:まだまだ加速するAI投資の実情が分かる!