2026年のAI競争は、もはや「どのモデルが賢いか」という判断を人間が下すことは難しくなっている。問われているのはデータをもとに「誰が実戦で使えるか」だ。そんな中、Googleが投入してきた Gemini 3.1 Pro。17項目のベンチマーク中12項目でトップを獲得。数字だけ見れば圧勝に見える。

だが、データを深く掘り下げると、単純な「圧勝」では語れない、もっと複雑な構造が見えてきた。

まず「勝利数」の全体像を把握する

今回の比較対象はGemini 3 Pro、Claude Sonnet 4.6、Claude Opus 4.6、GPT-5.2、GPT-5.3-Codexの5モデル。全17ベンチマーク項目にわたる直接対決を集計した結果がこれだ。

| モデル | 勝利数 | 参加数 | 平均スコア |

|---|---|---|---|

| Gemini 3.1 Pro | 12 | 17 | 70.1% |

| Claude Opus 4.6 | 4 | 15 | 71.0% |

| Gemini 3 Pro | 2 | 17 | 60.6% |

| GPT-5.3-Codex | 2 | 3 | 66.3% |

| Claude Sonnet 4.6 | 1 | 14 | 70.7% |

| GPT-5.2 | 0 | 17 | 65.4% |

ここに、最初の逆説がある。

Gemini 3.1 Proは12勝しながら、平均スコアではClaude Opus 4.6(71.0%)とSonnet 4.6(70.7%)の両方に負けている。 GPT-5.2は17項目全参加で1勝もできていないが、平均は65.4%と決して壊滅的ではない。

これが意味するのは、「Geminiは1位を多く取るが、競合との差は薄い」という構造だ。言い換えれば、Claudeは1位の数は少ないが、2位・3位でも高水準を維持している。どちらが「実用的に優れているか」は、用途によって答えが変わる。

ARC-AGI-2:この1項目が「別格」である理由

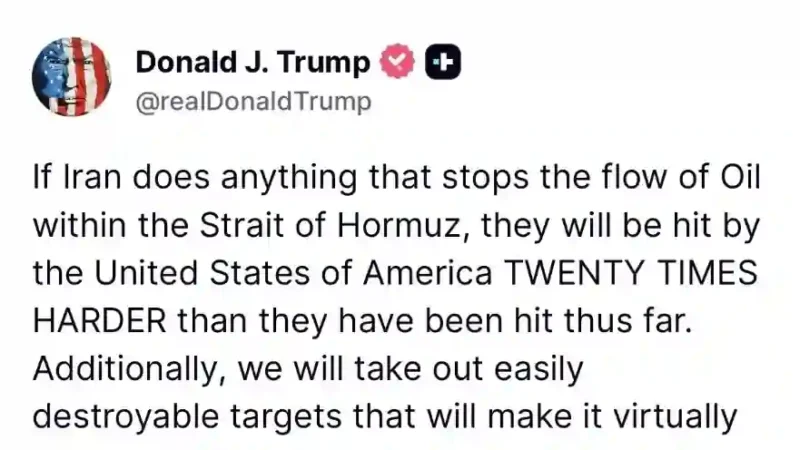

それでも、Gemini 3.1 Proを語るうえで避けて通れない数字がある。

ARC-AGI-2:77.1%

AGI(汎用人工知能)への到達度を測るとも言われる、現存する最難関クラスのベンチマークだ。この項目における各モデルのスコアを並べると、差の深刻さがわかる。

| モデル | スコア | Geminiとの差 |

|---|---|---|

| Gemini 3.1 Pro | 77.1% | — |

| Claude Opus 4.6 | 68.8% | -8.3pt |

| Claude Sonnet 4.6 | 58.3% | -18.8pt |

| GPT-5.2 | 52.9% | -24.2pt |

| Gemini 3 Pro | 31.1% | -46.0pt |

8pt差でも十分な圧勝だが、何より衝撃的なのは前世代Gemini 3 Proとの差だ。31.1% → 77.1%、わずか1世代で+46pt。 これは「改善」ではなく「変容」と呼ぶべき跳躍である。

他のベンチマークでも世代間の進化は見られるが(BrowseComp +26.7%、APEX-Agents +15.1%など)、ARC-AGI-2の+46ptはダントツで最大値だ。Gemini 3.1 Proが単なる「マイナーアップデート」ではないことを、この数字が証明している。

直接対決で見る「実力差」の実態

勝利数の集計に続いて、直接対決のスコアも精査した。

Gemini 3.1 Pro vs GPT-5.2(共通16項目)

結果は15勝1敗。GPT-5.2が上回ったのはSWE-Bench Pro Public(多様なコーディングタスク)の1項目のみで、その差はわずか+1.4pt。ほぼあらゆる領域でGemini優位という、Googleにとってこれ以上ない検証結果だ。

Gemini 3.1 Pro vs Claude Opus 4.6(共通15項目)

こちらは11勝3敗。Opusが上回った3項目は以下のとおり。

- Humanity’s Last Exam(検索+コード): Opus 53.1% vs Gemini 51.4%(-1.7pt)

- t2-bench Retail(ツール活用): Opus 91.9% vs Gemini 90.8%(-1.1pt)

- SWE-Bench Verified(コーディング): Opus 80.8% vs Gemini 80.6%(-0.2pt)

いずれも差は小さい。だが「研究者レベルの学術問題」と「実務ツール活用」という、まさにClaudeが得意とする領域でしっかり食らいついていることは、Claude陣営にとって希望の光と言えよう。

カテゴリ別「強み・弱み」マップ

5つのカテゴリに分類して各モデルの平均スコアを算出すると、各陣営の「顔」がより鮮明になる。

| カテゴリ | Gemini 3.1 Pro | Claude Sonnet 4.6 | Claude Opus 4.6 | GPT-5.2 |

|---|---|---|---|---|

| 知識・推論 | 77.1% ★ | 67.7% | 72.8% | 67.3% |

| コーディング | 65.6% | 61.9% | 66.1% ★ | 60.4% |

| エージェント(勝利数) | 4勝 ★ | 0勝 | 2勝 | 0勝 |

| マルチモーダル | 80.5% | 74.5% | 73.9% | 79.5% |

| 長文理解(128k) | 84.9% | 84.9% | 84.0% | 83.8% |

| 長文理解(1M) | 26.3% | 未対応 | 未対応 | 未対応 |

エージェント系でひとつ注釈を入れておく。Claude Sonnet 4.6のエージェント平均スコアは81.4%と高く見えるが、これはt2-bench(ツール活用)2項目で97〜91%という高スコアをたたき出しているためだ。ただしAPEX-AgentsやMCP Atlas、BrowseCompでは未参加またはGemini以下で、エージェント系の勝利数はゼロ。数字の文脈を読まないと誤解を生む典型例だ。

コーディングカテゴリでは、Claude Opus 4.6が平均66.1%でGemini 3.1 Pro(65.6%)をわずかに上回っている。「Gemini万能」という印象に、ここで最初のヒビが入る。

Gemini 3.1 Proが「負けた」項目を正直に見る

17項目の順位を全公開すると、Gemini 3.1 Proがトップでなかった項目は以下の6つだ。

| ベンチマーク | 順位 | 首位モデル | 差 |

|---|---|---|---|

| SWE-Bench Verified | 2位 / 5位 | Claude Opus 4.6 | -0.2pt |

| MMMU Pro(マルチモーダル) | 2位 / 5位 | Gemini 3 Pro | -0.5pt |

| HLE(検索+コード) | 2位 / 5位 | Claude Opus 4.6 | -1.7pt |

| t2-bench Retail | 3位 / 5位 | Claude Opus 4.6 | -1.1pt |

| SWE-Bench Pro Public | 3位 / 4位 | GPT-5.3-Codex | -2.6pt |

| Terminal-Bench(自己申告値) | — | GPT-5.3-Codex | 77.3%(条件差あり) |

注目したいのはマルチモーダル(MMMU Pro)だ。前世代のGemini 3 Proに0.5pt差で負けている。3.1 Proへのアップグレードでマルチモーダル推論がわずかに後退した可能性があり、これは今後の改善余地を示唆している。

SWE-Bench Pro PublicではGPT-5.3-Codexが首位(56.8%)だが、Codexは参加項目がこの3つのみで汎用評価は難しい。特化型モデルとしての強みを見せた形だ。

最重要な発見:致命的な弱点は存在しない。最大の敗北でも-2.6ptという接戦であり、「Gemini 3.1 Proに手が届かない領域」は現状見当たらない。

「1Mトークン」という次元の異なる戦場

長文理解の比較で、見落としてはならない事実がある。

MRCR v2(長文コンテキスト性能)の128kトークン条件では、Gemini 3.1 Pro(84.9%)とClaude Sonnet 4.6(84.9%)が完全同点。だが1Mトークン条件では状況が一変する。

Gemini 3.1 Proは26.3%を記録。対して、Claude Sonnet 4.6・Opus 4.6・GPT-5.2は「未対応」だ。1Mトークンは英語の小説約6冊分、日本語の書類なら数千ページ分に相当する。企業の膨大なドキュメントやコードベース全体を一度に処理したい用途では、現時点でGeminiが唯一の選択肢に近い。26.3%というスコア自体は高くないが、「そもそも挑戦できるか否か」という差は大きい。

検索拡張(RAG)実装ではなくコンテキストウィンドウの拡張こそが、AIエージェントの性能向上に必要だろうという分析もある。どのAIモデルも性能向上とコンテキストウィンドウの増加を目指している状況において、Geminiは頭一つ抜けていると言えるだろう。

結論:「ベンチマーク王」の正体は「万能な安定性」

今回の深層検証を一言で要約するなら、こうなる。

Gemini 3.1 Proは「圧勝」ではなく「圧倒的な安定性」で勝っている。

12/17という勝利数の裏には、平均スコアでClaude勢に僅差で下回るという構造がある。つまり「1位を量産するが差は薄い」モデルだ。これはむしろ、どんな用途でも一定以上の品質を出せる「万能型」の証明と読むべきだろう。穿った見方をすれば評価のポイントを着実に稼いでくるベンチマークハッカーだろう。

ARC-AGI-2での+46pt跳躍は、推論エンジンの根本的な再設計を感じさせる。エージェント系4項目全勝、GPT-5.2に15勝1敗という直接対決の数字は、2026年前半時点における「実用AIの基準値」をGemini 3.1 Proが更新したことを示している。

一方でClaudeは「研究・学術」「実務ツール活用」という特定領域で粘り強く食らいつき、コーディング平均ではOpus 4.6がGeminiをわずかに凌駕する。「専門特化」での逆転余地は、確かに残っている。コーディングにおいては、筆者もGeminiにベンチマーク以上に明確な弱さを感じている。課題解決能力において性能不足感は否めない。Geminiはもっぱら資料作成に使用している(この記事の資料画像もGemini3 Proで作られたものを多用している。)

今日の数字が明日も正しいとは限らない。だが今この瞬間、万能性という尺度においてGemini 3.1 Proが頂点にいる——それは、データが語る揺るぎない事実だ。

| カテゴリ | 最強モデル | 根拠 |

|---|---|---|

| 抽象推論・AGI系 | Gemini 3.1 Pro | ARC-AGI-2:77.1%(2位に8.3pt差) |

| 科学的知識 | Gemini 3.1 Pro | GPQA Diamond:94.3% |

| エージェント全般 | Gemini 3.1 Pro | 4項目全勝 |

| 競技プログラミング | Gemini 3.1 Pro | LiveCodeBench Elo 2887 |

| 多言語 | Gemini 3.1 Pro | MMMLU:92.6% |

| コーディング(平均) | Claude Opus 4.6 | 平均66.1% vs Gemini 65.6% |

| 学術研究(検索+コード) | Claude Opus 4.6 | HLE:53.1% |

| 専門家タスク(Elo) | Claude Sonnet 4.6 | GDPval-AA Elo:1633 |

| ターミナルコーディング | GPT-5.3-Codex | Terminal-Bench 2.0:77.3% |

| 超長文(1Mトークン) | Gemini 3.1 Pro | 唯一対応・26.3% |

データ出典:Gemini 3.1 Pro 公式ベンチマーク比較表

手法詳細:deepmind.google/models/evals-methodology/gemini-3-1-pro