ヒューマノイドロボットの開発において、空間認識や環境理解のためにどのようなセンサーを採用するかは、各社の設計思想を分ける重要な要素となっています。現在、主に「カメラのみ(ビジョンオンリー)」によるアプローチと、LiDAR(光による検知と測距)などの「複合センサー」を用いるアプローチが存在しているのです。

センサー構成の比較

ヒューマノイド市場における代表的なアプローチの比較は以下の通りです。

| 項目 | テスラ(Optimus) | 他社(Boston Dynamics, Figureなど) |

| 主なセンサー | カメラ(ビジョンオンリー) | LiDAR、深度カメラ、RGBカメラの複合 |

| 空間認識の手法 | 2D画像からAIネットワークを用いて3D空間を推論 | レーザー反射による物理的かつ直接的な3D点群データの取得 |

| 設計の前提 | 人間と同様に視覚情報のみで世界を理解できるという仮説 | 正確な物理データに基づく確実な動作とフェイルセーフ |

| 利点 | 部品コストの削減、ハードウェア構造の簡略化 | ミリ単位の正確な測距、暗所や悪天候下での安定した認識 |

| 課題 | 視覚的な錯覚や推論エラーのリスク、膨大な学習データが必要 | センサー部品の高コスト化、情報統合による処理の複雑化 |

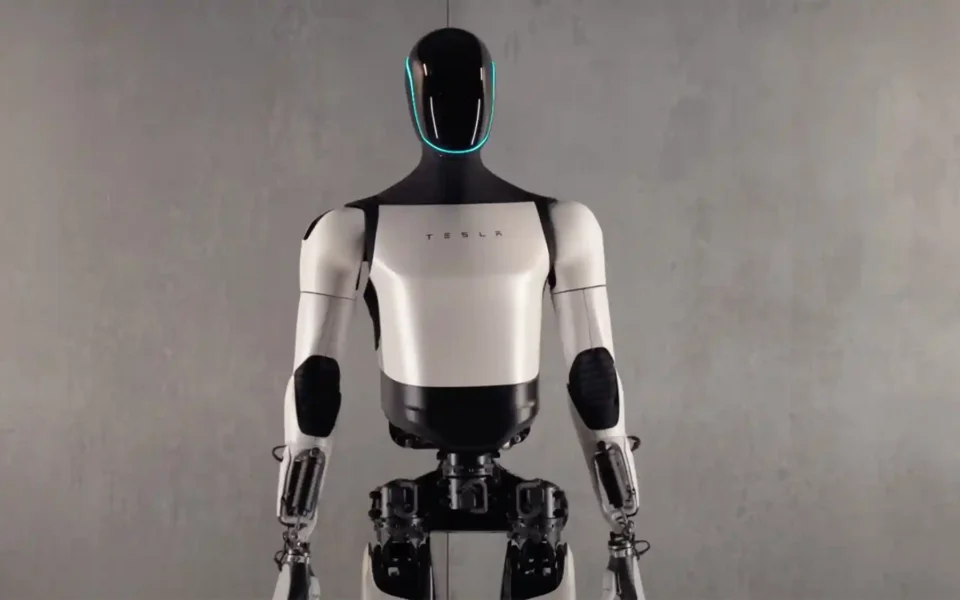

テスラの設計思想:ビジョンオンリー

テスラのヒューマノイド「Optimus(オプティマス)」は、同社の電気自動車に搭載されているFSD(Full Self-Driving)の技術を基礎としています。LiDARや超音波センサーを排除し、複数台のカメラから得られる視覚情報と、ニューラルネットワークによる画像認識・推論のみで環境を把握するアプローチです。これは「人間が目で見て状況を判断するように、AIもカメラからの視覚情報だけで動作可能である」という思想に基づいています。環境把握さえできれば十分だという設計思想と言えるでしょう。

自動運転においては、現状、このアプローチは成功を収めています。

他社の設計思想:LiDARと複合センサー

Boston Dynamicsの「Atlas」やFigureの「Figure 01/02」、Agility Roboticsの「Digit」など、他社の多くは頭部や胴体にLiDARや深度カメラ(ToFセンサーなど)を搭載しています。

LiDARはレーザー光を照射し、反射して戻ってくるまでの時間から対象物までの正確な距離と形状を測定します。これにより、周囲の環境を正確な3Dマップ(点群データ)として即座に構築することが可能となり、視覚的な錯覚や照明条件に左右されない安定した動作基盤を獲得できます。

「他の物体との距離を測定する」ということは、協働ロボットとしてのヒューマノイドを考える際に、2重3重の安全対策が施すことができます。一方、制御にも用いるパラメーターが増え、制御が複雑化するという課題もあります。

自動運転とヒューマノイドにおける環境適応の違い

テスラは自動車の自動運転において、カメラのみのアプローチで一定の成功を収めています。しかし、自動車の運転とヒューマノイドの制御では、その前提となる環境と必要な感覚情報に決定的な違いがあるかもしれません。

自動車:視覚情報への最適化

道路、白線、一時停止標識、信号機といった交通インフラは、すべて「人間の視覚」によって認識されることを前提に設計されています。自動車の操作も、アクセル、ブレーキ、ステアリングという限定的な入力のみで行われます。環境自体が視覚的ルールに従って構築されているため、視覚情報をAIで解析して車両を操作するというアプローチは合理的だと言えるでしょう。

ヒューマノイド:視覚と触覚の統合による判断

一方で、ヒューマノイドが活動する現実空間は、視覚情報のみで成立しているわけではありません。人間は物理世界と相互作用する際、視覚だけでなく、皮膚の「触覚」や、筋肉・関節の動きを感じ取る「固有受容覚」を高度に統合して判断を下しています。

階段を上る際の足裏の感覚、未知の形状の物体を掴む際の指先の圧力調整、滑りやすい床でのバランス維持など、これらは視覚による事前の予測だけでなく、接触した瞬間の物理的なフィードバックに大きく依存しています。

触れた後、物との距離感を人間は見ることなく把握することができます。

カメラのみアプローチの限界と今後の課題

ヒューマノイドにおいてカメラのみのアプローチを採用する場合、自動車の運転では表面化しなかった以下のような限界に直面する可能性があります。

- 直接的な物理測距の欠如カメラ映像からの距離推定は、あくまでAIによる「推論」です。LiDARのように光の反射による直接的な物理計測ではないため、未知の物体や複雑な形状に対するミリ単位の正確なアプローチにおいて、計算誤差が生じるリスクがある。

- 視覚的フィードバックと物理的接触のギャップロボットが物体を操作する際、視覚情報のみに依存すると、接触後の微細な調整が困難になります。人間が触覚で行っている「滑り落ちそうな感覚」や「適切な力加減」を、視覚情報に基づく推論だけで完全に代替するには、現在のハードウェア(アクチュエータの力覚センサー等)とAIの統合においてまだ大きな技術的飛躍が必要。

- 環境変動への脆弱性照明が不足している空間や、模様のない単一色の壁面、透明なガラスなど、カメラの画像認識機能が低下する条件下において、空間を物理的にスキャンするLiDARを持たないことは、ロボットの自律性を著しく制限する要因となる。

テスラのビジョンオンリー・アプローチは、データ収集とAIの進化によって視覚的推論の精度を極限まで高める試みです。しかし、人間が「触覚」という物理的フィードバックを伴って世界を認識している事実を考慮すると、空間を物理的に直接計測するLiDARの役割を視覚情報のみで完全に補完できるかについては、ヒューマノイドの複雑な物理タスクにおいて依然として疑問の余地が残っています。

ヒューマノイドを設計するうえで、まだ「これが正解」というような物は出てきていませんので、どこが勝者になるかは分かりません。ヒューマノイドのハードウェア部分の製造と、動かすためのソフトウェア側の設計が分離するような未来が来るのかもしれません。

いつか現れるであろう完成されたヒューマノイドにLiDARはついているのでしょうか?気になりますね。