Cursor「Composer 2」とは何か

2026年3月19日、AIコーディングIDE「Cursor」を開発するAnysphereは、自社開発モデル「Composer 2」の提供開始を発表した。

Composerとは、Cursor上でコードの生成・編集・リファクタリングを担うエージェント機能において中核モデルとして使用できる。ファイルをまたいだ複雑な変更や、ターミナル操作を含む一連の開発作業を、ユーザーの指示から自律的に実行する。Composer 2はその第3世代(Composer 1、Composer 1.5の後継モデル)にあたる。

そして、今回のComposer 2について一番興味深いことは、Cursor発表によると他社のAIモデルに匹敵する性能をたたき出している点だ。

比較対象は「汎用モデル」ではなく、GPT-5.4とOpus 4.6だった

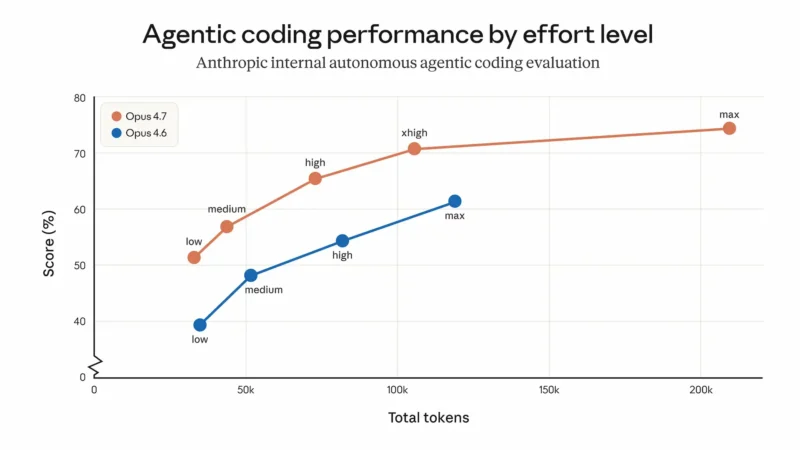

Cursorが公開したグラフでは対戦相手として具体的なモデル名が言及されている。GPT-5.4とClaude Opus 4.6。どちらも現時点で最高クラスに位置するモデルだ。

and scaled reinforcement learning

出典:Cursor公式ブログ(2026-03-19)/Terminal-Bench 2.0はLaude Institute管理のエージェント評価ベンチマーク。

Terminal-Bench 2.0のスコアを見ると、GPT-5.4が75.1%でトップに立つ。その次がComposer 2の61.7%だ。Claude Opus 4.6(58.0%)、Opus 4.5(52.1%)、そして前世代のComposer 1.5(47.9%)がそれに続く。Composerは「並んでいる」わけではなく、GPT-5.4には届いていない。しかしOpus 4.6を上回った、という事実は面白い。Anthropicが最上位に位置づけるモデルを、AI×コーディングIDEで一躍大きくなったスタートアップが自社モデルで超えたのだ。

コストパフォーマンスこそが本当の勝負所

より鮮明な差が出るのがコストとのトレードオフだ。CursorBenchのパフォーマンス対コストのグラフを見ると、構図が一目でわかる。

出典:Cursor公式ブログ(2026-03-19)/X軸右方向ほど低コスト。各点はタスクあたり中央コストとCursorBenchスコアを示す。

| モデル | スコア | コスト/タスク |

|---|---|---|

| Composer 2 | ~$0.50 | |

| GPT-5.4 (high) | ~$1.50 | |

| GPT-5.4 (med) | ~$0.75 | |

| GPT-5.4 (low) | ~$0.50 | |

| Opus 4.6 (high) | ~$2.50 | |

| Opus 4.6 (med) | ~$1.50 | |

| Opus 4.6 (low) | ~$1.00 | |

| Composer 1.5 | ~$1.00 |

出典:Cursor公式ブログ(2026-03-19)/数値は画像より読み取り近似値。

GPT-5.4はhighモード(推定コスト$1.50前後)でCursorBenchスコア約63%を出すが、コストが上がるほどパフォーマンスが下がるという奇妙な逆転現象もある。Opus 4.6(high)はコスト$2.50超でスコア約57%。一方、Composer 2はコスト約$0.50(タスクあたりの中央値)でスコア約61%に達している。

つまりComposer 2は、Opus 4.6(high)の5分の1以下のコストで、それを上回るスコアを出しているということだ。GPT-5.4にはやはり性能で劣るが、コスト効率では大きく上回る。

速度面でも同様の構図がある。Composer 2 Fastは200トークン/秒を超える速度を誇り、比較対象のなかで最速クラスだ。そのコストは出力100万トークンあたり数ドル程度と、Opus 4.6 Fast($150超)と比べると桁が違う。

おそらくモデルのパラメーターの大きさが控え目なのだと思われる。

なぜCursorにこれができたのか

Composerの性能向上の背景には、二段階のアプローチがある。

まず「継続事前学習」だ。既存の優れたベースモデルの上に、コーディングに特化したデータで追加学習をかける。最近は優れたベースモデルがMITライセンスやApach2.0ライセンスで数多く公開されている。ゼロからフロンティアモデルを構築するために必要な数千億円規模の計算資源は不要で、既存モデルをコーディングの文脈に引き寄せる作業に集中できたわけだ。

その土台の上で「大規模・複合的な開発作業におけるコーディングに特化した強化学習」を実施している。何百ものアクションを連続して実行する必要がある複雑な開発作業、リポジトリ横断のリファクタリング、複数ファイルにまたがる機能追加、ターミナル操作を含む自動化タスクなど、ありとあらゆることを正解・不正解の報酬信号で繰り返し学習させることで、汎用モデルが苦手とするシナリオでの精度を引き上げたようだ。

ベースモデルはKimi K2.5との噂がどうやら有力

Xでは、CursorのComposer 2がOpenAI互換API経由でKimi K2.5モデル(kimi-k2p5-rl-0317-s515-fast)を使用していることを、デバッグサーバーによるリクエスト傍受で発見したことを報告する声が上がっている。

そのリプライ欄の中にはElon Musk氏も「それはKimi 2.5だ」との発言を行っている。

フロンティアモデルをゼロから作らなくても、特定領域で部分的に上回れることは興味深い

Composer 2はGPT-5.4に性能で劣る。その点は事実として押さえるべきだ。しかしコーディングというドメインに絞り、コストと速度を含めた総合的な実用価値で評価すると、Cursorは現時点でGPT-5.4を含む汎用モデルに対して優位とまでは言えないが、以前までの「最新のAIモデルを作る企業じゃないと、AI×IDEでのビジネスはいつか行き詰る」という主張は通じなくなっただろう。やはり、オープンウェイトなAIモデルが増えたことも一因としてありそうだ。

AI競争の全体像を「誰が最も賢いモデルを作れるか」という一軸で捉えると、Cursorは負けているように見える。しかし「誰が最も実用的な開発体験を最もコスト効率よく届けられるか」という軸で見ると、話は変わる。Cursorはその軸に特化して戦っている。

https://cursor.com/ja/blog/composer-2

最近増えているオープンウェイトのAIモデルについて知りたい方はこちらの記事がおすすめです。