2026年3月16日、NVIDIAの年次イベント「GTC 2026」で次世代AIプラットフォーム「Rubin(ルビン)」がベールを脱ぎました。

NVIDIA自社製CPU「Vera(ヴェラ)」の鮮烈なデビューが注目を集める一方で、「裏の主役」として、Intel Xeon 6がDGX Rubin NVL8システムのホストCPUに採用されたことがインテルのニュースルームで発表されました。

なぜNVIDIAは、自社製CPUを搭載しながらIntel Xeonを採用しているのでしょうか?その裏側には、単なる互換性を超えた技術的合理性と、AI推論時代の新たな要件があるのです。

AI推論の「指揮者」としてのホストCPU

AIワークロードの重心が学習から推論へとシフトするにつれ、CPUの役割も変わってきました。かつてはGPUにデータを流す係だったが、今のエージェントAIシステムではワークロード全体のスケジューリングと管理を担う立場にいることが多々あります。

Xeon 6がこの領域で使われる背景のひとつは、x86との互換性です。世界中のデータセンターで動いているソフトウェアスタックとそのまま動く。Blackwellプラットフォーム向けに作った設計をRubin世代に持ち込めるため、書き直しが少なくて済む……というわけです。

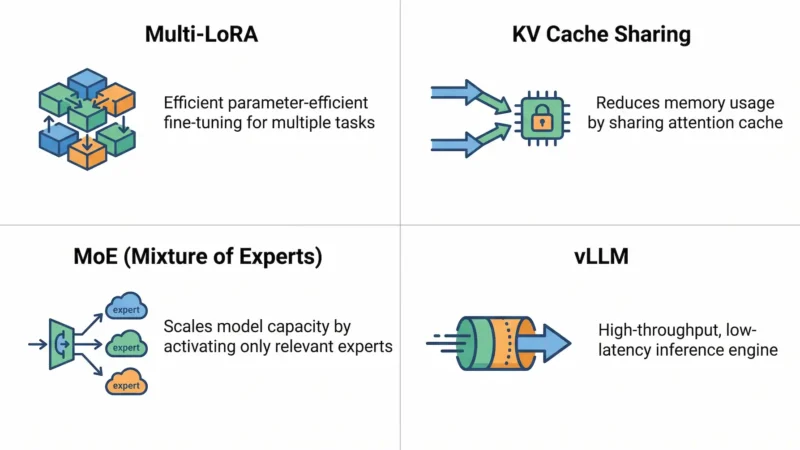

メモリ帯域の理由もあります。MRDIMMは前世代の3倍の帯域を持っています。LLM推論ではKVキャッシュが膨らむので、CPUとGPUの間でデータを途切れなく流せるかどうかが効率のボトルネックになりやすい。システムメモリは最大 8TBまで対応しているというのだから驚きです。

セキュリティについては、Intel TDXでハードウェアレベルの分離が使える点で優秀です。AIモデルや学習データをプロセス外から保護する仕組みで、マルチテナント環境でも機密データを扱いやすくなります。インテルの蓄積した歴史・技術は今もお金を稼いでいるわけです。

「Vera」と「Xeon」似て非なる2つの戦略

NVIDIAの自社製CPU「Vera」と、今回採用された「Intel Xeon 6」は、Rubinプラットフォーム内でも明確に役割が分かれています。

| 特徴 | NVIDIA Vera (Armベース) | Intel Xeon 6 (x86アーキテクチャ) |

| 搭載システム | Vera Rubin NVL72 (ラックスケール) | DGX Rubin NVL8 (8-GPUノード) |

| 接続方式 | NVLink-C2C (超高速独自接続) | 標準PCIe 5.0 / 6.0 |

| メインターゲット | 最大効率を求める大規模AI工場 | 既存資産を活かす企業データセンター |

| 強み | GPUとの統合性と電力効率 | 汎用ソフトウェア互換性と安定性 |

お互いに得意分野を担っているという表現が正しいでしょう。

結論:x86とArmの「ハイブリッド共存」時代へ

NVIDIAがVeraを強力に推進する一方で、Intel Xeonを「ミッションクリティカルなホストCPU」として重用し続けている事実は、データセンターにおけるx86アーキテクチャの根強い信頼性と適応力を示していそうです。つまり、まだまだ現役。

特に推論ワークロードのスケーリングにおいては、Priority Core TurboのようなXeon独自の機能が、GPUのデータフローを維持し、複雑なスケジューリングを効率化する鍵となります。

Nvidiaとintel。最近は特にギクシャクしている雰囲気がありましたが、お互いの長所を生かして、しっかり実利を取る連携をしています。AI時代でも、両者の関係性はこれからも続きそうです。